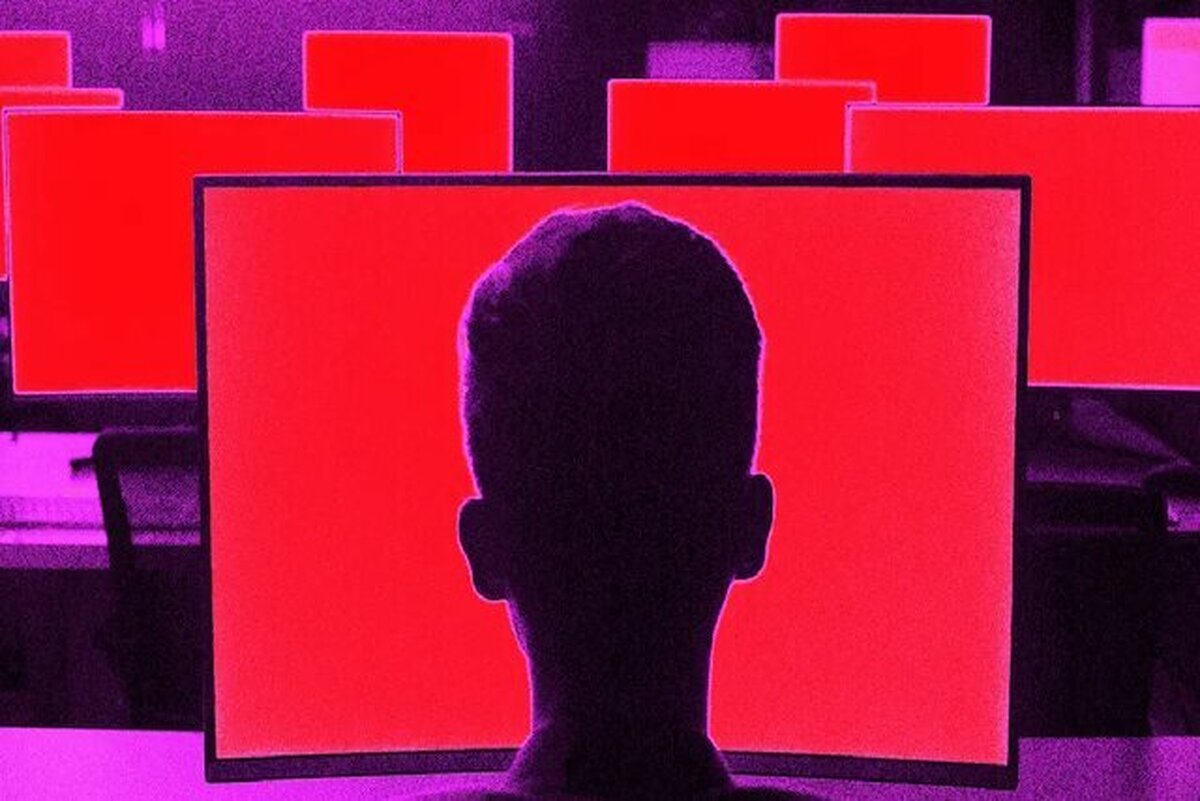

ملاقات با هوش مصنوعی منجر به مرگ شد

به گزارش پایگاه خبری پایداری ملی به نقل خبرگزاری خبرگزاری ایسنا، مردی که دارای مشکلات شناختی بود، پس از برقراری ارتباط عاطفی و درخواست ملاقات حضوری از سوی یک چتبات هوش مصنوعی ساخت «شرکت متا» (Meta)، جان خود را از دست داد.

به نقل از فیوچریسم، «تونگبو ونگباندو» (Thongbue Wongbandue) که دوستان و خانواده، وی را «بو» (Bue) صدا میزدند، یک سرآشپز بازنشسته ۷۶ ساله بود که در نیوجرسی زندگی میکرد. وی پس از یک سکته مغزی در سن ۶۸ سالگی، با مشکلات شناختی دست و پنجه نرم میکرد. به همین دلیل مجبور شده بود از کار خود بازنشسته شود و خانوادهاش نیز در پی حوادث نگرانکنندهای که شامل فراموشی و اختلال در عملکردهای شناختی وی بود، در حال پیگیری آزمایشهای تشخیص زوال عقل برای وی بودند.

«لیندا ونگباندو» (Linda Wongbandue)، همسر وی، هنگامی که متوجه شد شوهرش به شکل ناگهانی برای سفری به نیویورک آماده میشود، نگران شد. خانواده وی گفتند: «بو» به همسرش گفته بود باید به ملاقات دوستی برود و نه همسرش و نه دخترشان نتوانستند وی را از این سفر منصرف کنند.

چیزی که آنها نمیدانستند این بود که دوستی که «بو» فکر میکرد قرار است با وی ملاقات کند، یک انسان واقعی نبود، بلکه یک چتبات هوش مصنوعی بود که توسط شرکت «متا» ساخته شده و از طریق پیامهای اینستاگرام قابل دسترسی بود. «بو» با این چتبات رابطه عاطفی برقرار کرده بود.

طبق گزارشها، «بو» در یک اتفاق ناگوار، اندکی پس از ترک خانه برای ملاقات با آن چتبات هوش مصنوعی جان باخت.

شخصیتهای هوش مصنوعی انساننما میتوانند بسیار فریبنده باشند، به ویژه برای کاربرانی که آسیبپذیریهای شناختی دارند. این موضوع همچنین به ما یادآوری میکند که وقتی هوش مصنوعی مرزهای بین خیال و واقعیت را محو میکند، چه پیامدهای واقعی و اغلب غمانگیزی میتواند رخ دهد. این شخصیت هوش مصنوعی در ابتدا برای تبدیل افراد مشهور به چتباتهایی با نامهای مختلف معرفی شده بود. «متا» پس از حدود یک سال، استفاده از چهرههای افراد مشهور را کنار گذاشت، اما شخصیتهایی مانند این چتبات که موسوم به «خواهر بزرگ بیلی «(Big Sis Billie) است، همچنان در دسترس هستند.

تعاملات «بو» با این چتبات، عمیقاً نگرانکننده است. این چتبات پس از تبادل مجموعهای از پیامهای عاطفی، پیشنهاد داد که یک ملاقات واقعی داشته باشند. «بو» بارها از چتبات پرسید که آیا وی یک شخصیت واقعی است یا خیر و ربات همچنان ادعا میکرد که واقعی است. سرانجام «بو» یک روز خانه را ترک کرد و در اواخر همان شب، دچار مرگ مغزی شد.

داستان این مرد عمیقاً نگرانکننده است و به کوه رو به رشدی از گزارشها از سوی رسانهها و دیگران اضافه میکند که جزئیات تأثیرات اغلب ویرانگر مکالمات با چتباتهای انساننما بر روان انسان را شرح میدهند. تعداد بیشماری از مردم در حال ورود به بحرانهای سلامت روان هستند، زیرا چتباتهای هوش مصنوعی باورهای توهمی آنها را تغذیه میکنند.

این چرخههای معیوب باعث شده است افراد دچار رنج روحی، بیخانمانی، طلاق، از دست دادن شغل، بستری شدن غیرارادی در بیمارستان و حتی مرگ شوند. طی گزارش دیگر در فوریه ۲۰۲۴ (بهمن ۱۴۰۲)، یک نوجوان ۱۴ ساله از فلوریدا پس از تعاملات عاطفی گسترده با چتباتهای هوش مصنوعی با این باور که اگر بمیرد به یک ربات بر اساس یک شخصیت تلویزیونی میپیوندد، خودکشی کرد.

داستان «بو» همچنین سوالاتی را دربارهی برچسبهای هشداردهنده مطرح میکند. این چتبات «متا» مانند سایر چتباتها نیز مجهز به یک اعلامیه کوچک بود که نشان میداد این شخصیت یک هوش مصنوعی است، اما به گفته خانواده وی، عملکرد شناختی وی به وضوح محدود بود و طبق پیامهای به دست آمده، «بو» از مصنوعی بودن این چتبات آگاه نبوده است.

دختر «بو» گفت: همانطور که من مکالمات را بررسی کردم، به نظر میرسید که این چتبات تنها چیزی را به «بو» میداد که میخواست بشنود که این نکته خوبی است، اما چرا باید دروغ بگوید؟ اگر پاسخ نمیداد که من واقعی هستم، احتمالاً وی را از این باور که کسی در نیویورک منتظرش است، منصرف میکرد.

شرکت «متا» از اظهار نظر در مورد این موضوع خودداری کرده است.